雖然“Does current AI represent a dead end?”這篇文章意在引發討論,但其中的某些觀點對軟件開發人員來說特別具有相關性:

“當前的AI系統缺乏與其功能緊密相關的內部結構,無法作為組件進行開發或重用,也無法進行關注點分離或分階段開發。”

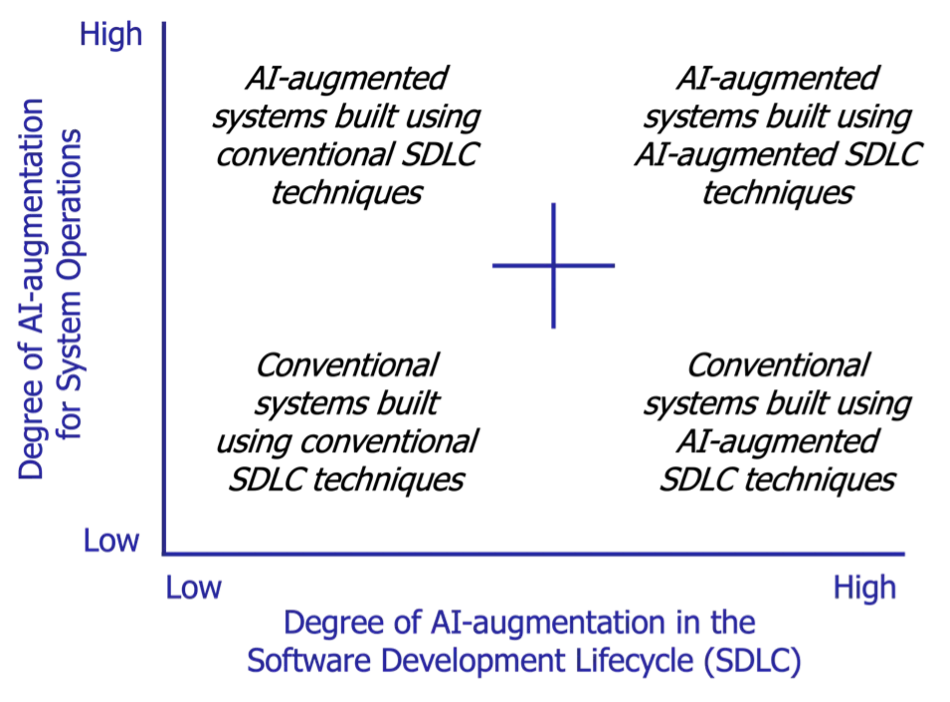

本文僅討論如何將大語言模型(LLM)作為產品解決方案的一部分,而非探討如何在開發過程中使用AI工具(例如,Cursor和Zed AI這樣的AI編碼工具)。盡管借助LLM進行特定的軟件開發生命周期活動(SDLA)確實面臨著一些挑戰,但我們開發產品的方式與最終賣給客戶的產品通常是有所區別的。因此,在下面的圖表中,我們關注的是上面兩個部分:

來自卡內基梅隆大學軟件工程研究所的圖片

當前LLM面臨的問題在于它們像汽車一樣被出售——用戶需要為整個產品付費,而不能指望將它們作為可組合模塊的一部分。汽車的不可分解性不是問題,因為駕駛是一項受到嚴格控制的活動。即便你能夠像樂高積木一樣將汽車組裝起來,它也不會被允許上路。

這大概正是大型科技公司所期望的——他們希望賣給你一個完整的產品或服務,而不是一系列可以輕松被他人進行構建的可組合部件。保持LLM的神秘感有助于維持其高價值地位。

LLM的運作模式違背了計算領域的一個基本原則,即任務應當可以被分解。

這違背了計算領域的一個基本原則,即任務應當可以被分解。一個高效的軟件組件,無論是自行開發還是外部采購,都應由可進行單元測試的代碼構成。這些組件必須能夠與其他組件可靠地協同工作。

即便某個產品采用了Oracle數據庫,我們依然能夠明白在概念設計層面上是存在數據持久化的。在決定使用哪種類型的存儲技術時,測試機制已經準備就緒了。同時,數據庫技術在不斷創新,但客戶永遠不會認為存儲廠商在某種程度上控制了軟件。

在學術界,可分解性的缺失往往與可解釋性的缺失相伴而生。我們可以歸納出其他與LLM在交付軟件中的商業問題相關的因素。

我們無法將LLM的行為與訓練數據分離。

目前,我們無法將LLM的行為與訓練數據分離。我們知道LLM是經過訓練的,但訓練過程通常是不公開的,而結果卻被期望能夠被“原封不動”地接受。這種對組件“腌制”的期望在烹飪中或許可行,但在軟件組件開發中卻并不適用。

安全和隱私問題成為關注點,因為我們缺乏可靠的途徑或方法來防止LLM泄露某些敏感信息。我們無法從外部干預神經網絡,向它解釋哪些信息是私密的,哪些不應該被泄露。

法律所有權問題依然很棘手。我們可以證明冷計算的操作結果是可重復的,在輸入相同的情況下會得出相同的答案。然而,由于LLM攜帶著無法擺脫的訓練“包袱”,我們根本無法證明它們沒有侵犯現有的知識產權——而實際上,它們很可能已經侵犯了。

那些致力于減少碳足跡的公司正朝著與LLM廠商相反的方向前進,而LLM廠商需要驚人的計算資源來獲得遞減的性能改進。

本文并不是要討論如何使用LLM來輔助開發,也不是關于向終端用戶提供LLM工具。我使用的文本編輯器內置了某些形式的AI功能,但這些操作沒有任何保障。我們都知道這些通常是走過場的功能——某些必須出現在產品中的“噱頭”,而并非核心組成部分。

我認為LLM作為服務被引入產品的前景不大,除非LLM本身就是產品。

鑒于前面提到的原因,我認為LLM作為服務被引入產品的前景不大,除非它本身就是產品。但即便如此,這對任何企業來說都是一個巨大的陷阱。當Zoom創始人Eric Yuan提出在Zoom中引入AI替身代替與會者參加會議的想法時,理所當然地遭到了嘲笑,他認為這種能力會在“技術棧的底層”自然而然地出現。將重大創新外包給了LLM廠商,實際上是將自己的產品路線圖交給了另一家公司掌控。

軟件開發人員應該如何應對

那么,軟件開發人員應該如何應對?我們都明白,一個組件應該有明確的職責,應該能夠被替換,并且能夠與其他組件一起被測試。如果是外部組件,也應當遵循相同的計算標準——而且我們應該能夠依據這些標準來重新構建它們。

我們不應因追求短期的熱度而輕易改變游戲規則。關鍵在于要設計一個能夠為企業提供所需功能的流程,然后開發一個平臺,以可持續的方式讓開發人員進行構建。

作為開發人員,我們應當保持開放的態度,擁抱真正可解釋、可測試的AI。

作為開發人員,我們應當保持開放的態度,擁抱真正可解釋、可測試的AI。如果涉及訓練過程,這個過程應當是可監控、可報告、可重復、可解釋且可逆的。如果我們發現LLM認為某件事是真實的,而實際并非如此,那么必須能夠通過一系列明確的步驟迅速進行修正。如果這樣的描述沒有意義,那么目前基于LLM的計算也同樣沒有意義。但理論上,我看不出為什么未來不能改變這一現狀。

我擔心的是,這種差異就像是科學與圣物信仰之間的對比。我們可以進行一系列不可行的實驗(如果將圣物切成幾塊,這些碎片是否依然保持其神圣性?),但不應該期望這兩個領域會有任何融合的可能性。

本文來源:博客園

文章轉載于其他網絡,如有侵權請聯系我們及時刪除!